Google DeepMind vient de publier Gemma 4, sa nouvelle famille de modèles open-weight sous licence Apache 2.0. Derrière l'annonce technique se cache un signal stratégique majeur : Google ouvre les vannes de ses modèles les plus performants pour reprendre la main sur l'écosystème open source face à Meta, Mistral et DeepSeek.

Chez Bridgers, nous avons analysé cette sortie sous l'angle qui compte pour les décideurs et les équipes techniques : ce que vous pouvez réellement déployer, à quel coût, et ce que cela change dans votre stratégie d'infrastructure IA.

Le constat est limpide. Gemma 4 ne se contente pas de proposer des benchmarks impressionnants sur le papier. La famille de quatre modèles couvre un spectre d'usages allant du smartphone au serveur de production, avec une licence qui élimine les zones grises juridiques que posaient les licences communautaires précédentes. C'est la première fois qu'un acteur de cette envergure propose simultanément des modèles edge, des modèles serveur et une architecture MoE, le tout sous Apache 2.0.

Pour comprendre ce que cela implique concrètement, il faut examiner chaque composant de cette annonce.

Quatre modèles, quatre segments de marché : la stratégie de couverture complète

La famille Gemma 4 se décline en quatre tailles qui ciblent des cas d'usage distincts. Cette segmentation n'est pas anodine : elle reflète la conviction de Google que l'IA de demain ne sera pas uniquement dans le cloud.

Les modèles E2B (2,3 milliards de paramètres effectifs) et E4B (4,5 milliards de paramètres effectifs) sont conçus pour le déploiement sur appareil. Ils acceptent du texte, des images et de l'audio en entrée, ce qui en fait les premiers modèles open-weight véritablement multimodaux pour l'edge. En quantification Q4\_0, le E2B tient dans 3,2 Go de mémoire. C'est suffisamment compact pour tourner sur un téléphone Android récent ou un Raspberry Pi bien équipé.

Le modèle 26B A4B utilise une architecture Mixture-of-Experts avec 25,2 milliards de paramètres au total mais seulement 3,8 milliards actifs par token. Ce ratio est remarquable : vous obtenez la qualité d'un modèle de 25 milliards avec la vitesse d'inférence d'un modèle de 4 milliards. La contrepartie, et elle est importante, est que la totalité des paramètres doit être chargée en mémoire pour le routage des experts. Comptez 25 Go en SFP8.

Enfin, le modèle 31B dense, avec ses 30,7 milliards de paramètres et une fenêtre de contexte de 256K tokens, se positionne comme le vaisseau amiral de la gamme. Il atteint 85,2 % sur MMLU Pro, 89,2 % sur AIME 2026 et 80,0 % sur LiveCodeBench v6. Ces chiffres le placent dans la catégorie des modèles frontier, tout en restant déployable sur un poste de travail équipé de deux GPU.

La licence Apache 2.0 : un changement de paradigme pour les projets enterprise

Jusqu'à présent, les modèles open-weight de Google utilisaient des licences « communautaires » qui introduisaient des restrictions sur l'utilisation commerciale et la redistribution. Gemma 4 marque une rupture nette avec ce modèle.

La licence Apache 2.0 signifie concrètement que vous pouvez modifier le modèle, le redistribuer, l'intégrer dans un produit commercial et même le vendre, sans négocier de licence supplémentaire. Pour les entreprises opérant dans des secteurs réglementés (finance, santé, défense), cette clarté juridique élimine un obstacle majeur à l'adoption.

Google parle explicitement de « souveraineté numérique » dans ses communications de lancement. Le terme n'est pas anodin. Il s'adresse directement aux entreprises européennes soumises au RGPD et aux réglementations sectorielles qui exigent un contrôle total sur les données et l'infrastructure de traitement.

Pour une agence comme Bridgers, qui accompagne des clients dans le déploiement de solutions IA, cette évolution simplifie considérablement l'architecture juridique des projets. Plus besoin de maintenir une analyse de conformité spécifique à la licence du modèle. Apache 2.0 est un standard compris par tous les départements juridiques.

La comparaison avec la concurrence est parlante. Meta Llama utilise une licence communautaire avec des restrictions au-delà de 700 millions d'utilisateurs mensuels. Mistral applique des licences différentes selon les modèles. DeepSeek opère sous une licence permissive mais avec des questions de gouvernance liées à sa juridiction chinoise. Google tranche dans le vif en adoptant le standard le plus ouvert disponible.

Benchmarks décortiqués : où Gemma 4 excelle et où il reste en retrait

Les benchmarks officiels de Google sont impressionnants, mais ils méritent une lecture nuancée. Voici ce que nous retenons de l'analyse comparative.

En raisonnement mathématique, le modèle 31B atteint 89,2 % sur AIME 2026 sans outils. C'est un score remarquable pour un modèle de cette taille. Le modèle MoE 26B A4B suit de près avec 88,3 %, ce qui confirme l'efficacité de l'architecture Mixture-of-Experts pour les tâches de raisonnement complexe.

En programmation, le 31B obtient un ELO Codeforces de 2150 et 80,0 % sur LiveCodeBench v6. Pour mettre ces chiffres en perspective, Gemma 3 27B plafonnait à 110 en ELO Codeforces et 29,1 % sur LiveCodeBench. Le saut de performance est d'un ordre de grandeur.

En vision, les résultats sur MMMU Pro (76,9 % pour le 31B) et OmniDocBench (0,131 en distance d'édition moyenne) positionnent Gemma 4 comme un concurrent sérieux pour les cas d'usage de traitement documentaire et d'analyse visuelle.

Le point faible relatif se situe sur les tâches agentiques. Le score Tau2 du 31B (76,9 %) est solide mais reste en deçà des modèles propriétaires les plus avancés. Pour les workflows multi-étapes complexes, Gemma 4 nécessitera probablement un scaffolding plus robuste que les solutions frontier fermées.

Pour les modèles edge, les résultats sont tout aussi notables. Le E4B atteint 69,4 % sur MMLU Pro et 52,0 % sur LiveCodeBench v6. Ce sont des scores qui auraient été considérés comme frontier il y a dix-huit mois, désormais accessibles dans un modèle de 4,5 milliards de paramètres tenant dans 5 Go de mémoire.

Déploiement local : planning mémoire et choix d'infrastructure

transparence de Google sur les exigences matérielles. Voici le tableau de planification mémoire pour les poids seuls.

Pour le modèle E2B : 9,6 Go en BF16, 4,6 Go en SFP8, 3,2 Go en Q4\_0. Pour le E4B : 15 Go en BF16, 7,5 Go en SFP8, 5 Go en Q4\_0. Le modèle 31B dense demande 58,3 Go en BF16, 30,4 Go en SFP8 et 17,4 Go en Q4\_0. Le 26B A4B MoE nécessite 48 Go en BF16, 25 Go en SFP8 et 15,6 Go en Q4\_0.

Ces chiffres n'incluent pas le cache KV pour les contextes longs ni la surcharge logicielle. Pour un déploiement en production avec un contexte de 128K tokens, prévoyez un facteur multiplicatif de 1,5x à 2x sur ces estimations.

La distribution est large : Hugging Face, Kaggle, Ollama, Google AI Studio, AI Edge Gallery et Android AICore Developer Preview. L'écosystème de serving est déjà en place avec vLLM, llama.cpp, MLX et SGLang. Cette couverture réduit considérablement le temps de mise en route pour les équipes.

Implications stratégiques pour les équipes qui construisent avec l'IA

L'arrivée de Gemma 4 modifie l'équation coût-performance-contrôle pour plusieurs profils d'utilisateurs.

Pour les startups et PME, le modèle 26B A4B MoE offre un rapport qualité-prix extraordinaire. Avec seulement 3,8 milliards de paramètres actifs par token mais des performances proches du 31B sur de nombreux benchmarks, il permet de servir des requêtes à haute qualité avec un budget d'inférence réduit. Si vous construisez un produit IA et que le coût API est un facteur limitant, ce modèle mérite votre attention immédiate.

Pour les grandes entreprises, la combinaison Apache 2.0 plus déploiement local plus contexte de 256K tokens ouvre la porte à des assistants internes fonctionnant entièrement on-premise. Les secteurs réglementés comme la banque ou l'assurance, qui ne pouvaient pas envoyer de données sensibles vers des API tierces, disposent maintenant d'une alternative crédible aux modèles propriétaires.

Pour les développeurs d'applications mobiles, les modèles E2B et E4B avec leur support audio natif permettent d'envisager des assistants vocaux embarqués fonctionnant hors connexion. C'est un cas d'usage qui était jusqu'ici réservé aux modèles propriétaires d'Apple et Google intégrés au système d'exploitation.

Ce que Gemma 4 ne résout pas : les limites à garder en tête

modèle ne produit que du texte en sortie. Pas de génération d'images, pas de synthèse vocale, pas de vidéo. Pour les pipelines multimodaux complets, vous aurez besoin de modèles complémentaires.

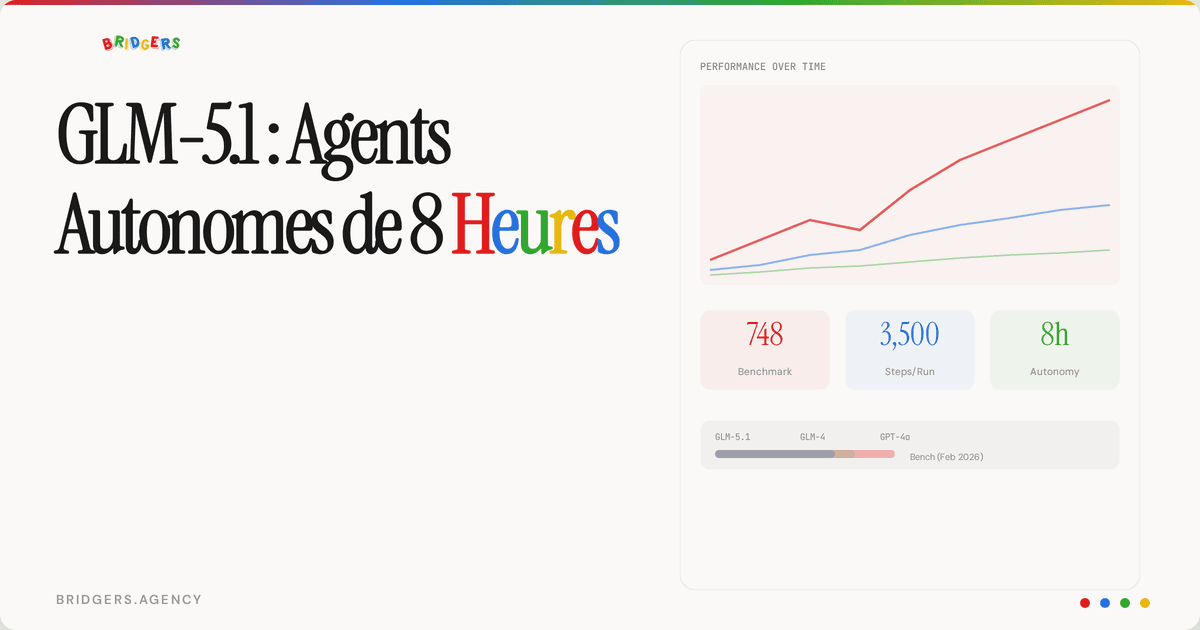

Les performances sur les tâches agentiques de longue durée restent en retrait par rapport aux modèles spécialisés comme GLM-5.1 ou aux solutions propriétaires de pointe. Si votre cas d'usage implique des agents autonomes fonctionnant sur des centaines d'itérations, Gemma 4 seul ne suffira probablement pas.

Enfin, le support linguistique mérite attention. Les benchmarks audio ne sont disponibles que pour l'anglais à ce stade. Pour les déploiements multilingues, particulièrement en français, des tests supplémentaires seront nécessaires avant de valider la qualité de production.

Conclusion : une pièce maîtresse dans votre stratégie IA open source

Pour les équipes techniques, la question n'est plus de savoir si les modèles open-weight peuvent rivaliser avec les solutions propriétaires. La question est de savoir comment optimiser votre stack pour tirer parti de cette nouvelle réalité. La réponse passera vraisemblablement par une architecture hybride : Gemma 4 en local pour les tâches sensibles et récurrentes, modèles frontier via API pour les cas d'usage les plus exigeants.

Chez Bridgers, nous recommandons aux équipes de commencer par le modèle 26B A4B MoE pour évaluer le rapport performance-coût sur leurs cas d'usage spécifiques. C'est le modèle qui offre le meilleur compromis entre qualité, vitesse d'inférence et empreinte mémoire. Si vos résultats confirment les benchmarks officiels, vous tenez peut-être la pièce centrale de votre infrastructure IA pour les mois à venir.

Envie d’automatiser ?

Audit gratuit de 30 min. On identifie vos 3 quick wins IA.

Réserver un audit gratuit →