L'industrie de l'IA évalue traditionnellement ses modèles sur des tâches ponctuelles : résoudre un problème mathématique, générer une fonction, répondre à une question de connaissances. GLM-5.1, publié par Z.ai (anciennement Zhipu AI) sous licence MIT, propose un changement de cadre radical. Le modèle est conçu pour fonctionner de manière autonome pendant huit heures sur une seule tâche, enchaînant des centaines de cycles d'itération et des milliers d'appels d'outils.

Ce n'est pas un raffinement incrémental. C'est une redéfinition de ce que signifie « performant » pour un modèle de langage dans un contexte agentique. Chez Bridgers, nous considérons que cette annonce marque un tournant dans la manière dont les équipes techniques devraient évaluer et sélectionner leurs modèles d'IA.

Pour comprendre pourquoi, il faut d'abord analyser ce que Z.ai a réellement construit, puis examiner ce que cela implique pour vos projets.

Z.ai : le laboratoire chinois qui passe à l'offensive sur l'open source

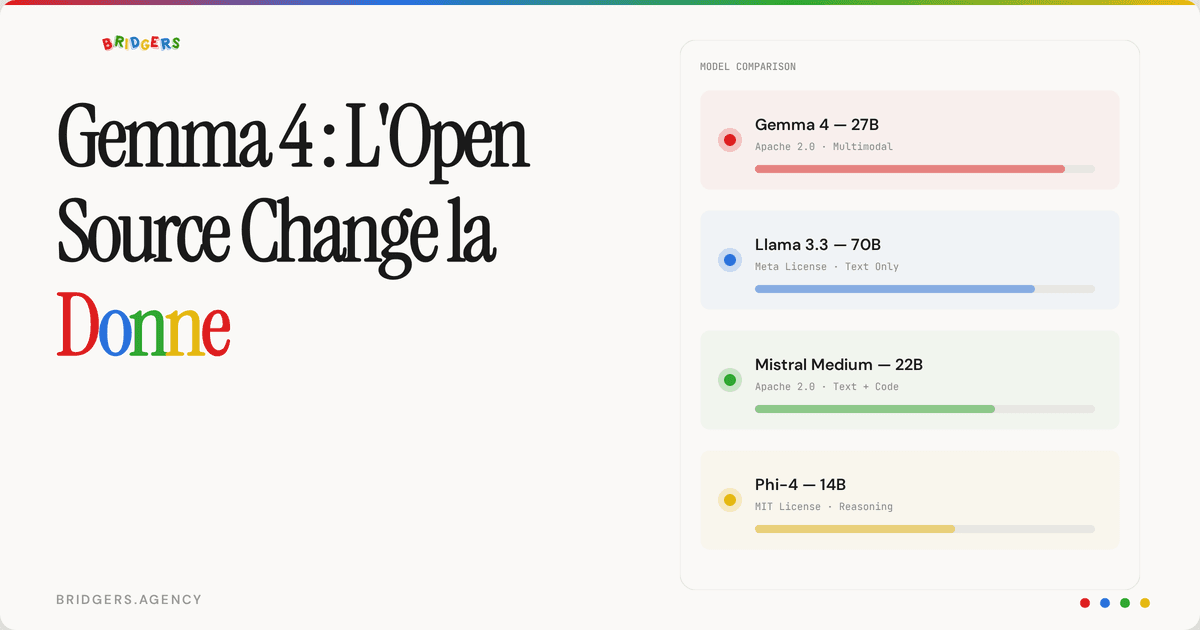

GLM-5.1 change cette donne. En publiant le modèle sous licence MIT avec les poids disponibles sur Hugging Face et ModelScope, Z.ai entre en compétition directe avec l'écosystème open source mondial. La licence MIT, encore plus permissive qu'Apache 2.0, n'impose pratiquement aucune restriction sur l'utilisation commerciale, la modification ou la redistribution.

Le signal stratégique est clair : la course aux modèles open source n'est plus un duel entre Meta et Google. Les laboratoires chinois jouent désormais cartes sur table, et la compétition s'intensifie au bénéfice de l'ensemble de l'écosystème.

Anatomie technique d'un modèle conçu pour l'endurance

Architecture Mixture-of-Experts avec DeepSeek-style MLA (Multi-head Latent Attention) et Dynamic Sparse Attention. La configuration comprend 256 experts routés avec 8 actifs par token, ce qui place le modèle dans la même catégorie architecturale que DeepSeek V3 tout en apportant des optimisations spécifiques pour les tâches de longue durée.

Les spécifications clés méritent d'être examinées en détail. Le modèle offre une fenêtre de contexte de 200K tokens et peut générer jusqu'à 128K tokens en sortie. Cette capacité de sortie massive est inhabituelle et délibérée : elle permet au modèle de produire des patches de code complets, des rapports détaillés ou des artefacts substantiels en une seule passe, sans les limitations de troncature qui affectent la plupart des modèles actuels.

Le déploiement local est supporté via vLLM, SGLang, xLLM, Transformers et KTransformers. L'API utilise un format OpenAI-compatible avec des paramètres spécifiques pour le « thinking mode », le streaming, les appels de fonctions, les sorties structurées et la mise en cache du contexte. Une fonctionnalité notable est le « tool\_stream », qui permet le streaming des arguments d'appels d'outils pendant l'exécution des fonctions.

Pour les équipes habituées à Claude Code ou OpenClaw, Z.ai annonce une compatibilité directe avec ces environnements, ce qui réduit considérablement la friction d'adoption.

L'innovation réelle : la performance qui ne se dégrade pas

Après quelques dizaines d'itérations, la plupart des modèles commencent à tourner en rond, à répéter des erreurs ou à perdre le contexte de la tâche initiale. GLM-5.1 prétend résoudre ce problème en maintenant sa capacité d'amélioration sur des centaines de rounds d'itération.

Les chiffres officiels illustrent cette différence. Sur VectorDBBench (SIFT-1M, Recall supérieur ou égal à 95 %), GLM-5.1 atteint 21 500 QPS après plus de 600 itérations et 6 000 appels d'outils. Pour mettre ce résultat en perspective, le meilleur résultat sur 50 tours rapporté par Z.ai pour Claude Opus 4.6 est de 3 547 QPS. L'écart n'est pas dû à une intelligence brute supérieure mais à la capacité du modèle à continuer d'optimiser là où d'autres plafonnent.

Sur KernelBench Level 3 (50 problèmes), le speedup géométrique moyen par rapport au baseline PyTorch eager est de 3,6x pour GLM-5.1. Par comparaison, torch.compile en mode default atteint 1,15x et max-autotune 1,49x. Claude Opus 4.6 atteint 4,2x sur ce même benchmark, ce qui montre que GLM-5.1 n'est pas systématiquement le meilleur sur chaque tâche mais offre un profil de performance compétitif à un coût potentiellement inférieur.

Benchmarks classiques : où GLM-5.1 se situe face à la concurrence

Sur SWE-Bench Pro, GLM-5.1 obtient 58,4, devançant GPT-5.4 (57,7), Claude Opus 4.6 (57,3) et Gemini 3.1 Pro (54,2). C'est un résultat solide qui confirme les capacités du modèle en résolution de bugs réels dans des dépôts logiciels.

Sur Terminal-Bench 2.0, le score de 63,5 place GLM-5.1 derrière Gemini 3.1 Pro (68,5) et Claude Opus 4.6 (65,4). Sur NL2Repo, le modèle atteint 42,7, significativement en retrait par rapport à Claude Opus 4.6 (49,8). Sur HLE (évaluation de haut niveau), GLM-5.1 ne dépasse pas 31,0, contre 45,0 pour Gemini 3.1 Pro et 39,8 pour GPT-5.4.

Le tableau est donc nuancé. GLM-5.1 n'est pas le meilleur modèle sur chaque benchmark individuel. Sa proposition de valeur réside dans sa capacité à maintenir un niveau de performance élevé sur la durée, ce qui est un critère fondamentalement différent des évaluations ponctuelles traditionnelles.

Cette distinction est cruciale pour les équipes qui construisent des agents. Un modèle qui obtient 65 sur un benchmark ponctuel mais maintient sa performance sur 1 700 étapes vaut potentiellement plus qu'un modèle à 70 qui se dégrade après 50 itérations.

Ce que GLM-5.1 change dans l'évaluation des modèles IA

Les benchmarks traditionnels mesurent la performance sur des tâches isolées et courtes. Or, les cas d'usage agentiques qui se développent dans l'industrie impliquent des exécutions de longue durée avec de multiples cycles d'itération.

Premièrement, la performance ponctuelle reste pertinente pour les cas d'usage de type question-réponse, résumé ou génération simple. C'est le terrain des benchmarks classiques comme MMLU, GPQA ou LiveCodeBench.

Deuxièmement, la performance agentique courte, mesurée sur des tâches de 10 à 50 étapes, évalue la capacité d'un modèle à utiliser des outils et à naviguer dans un environnement. SWE-Bench et Terminal-Bench entrent dans cette catégorie.

Troisièmement, la performance agentique de longue durée, telle que mesurée par les démonstrations de Z.ai sur VectorDBBench et KernelBench, évalue la capacité d'un modèle à maintenir sa trajectoire d'amélioration sur des centaines d'itérations. Cette catégorie n'a pas encore de benchmark standardisé reconnu par la communauté, ce qui est à la fois une opportunité et un risque en termes de comparabilité.

Implications pour vos architectures agentiques

Pour les équipes de développement logiciel, la combinaison d'une autonomie de 8 heures, d'une compatibilité avec Claude Code et OpenClaw, et d'une licence MIT offre un nouveau point de comparaison pour les agents de codage. Vous pouvez désormais tester un workflow où l'agent reçoit une spécification le matin et livre un prototype fonctionnel dans l'après-midi, avec des cycles d'itération continus entre-temps.

Pour les architectes de systèmes, la fenêtre de contexte de 200K tokens et la sortie de 128K tokens permettent des workflows où l'agent ingère un dépôt complet, analyse sa structure, identifie les problèmes et produit des corrections substantielles en une seule session. Cependant, ces longues sessions impliquent des coûts d'inférence significatifs. Z.ai propose un « Coding Plan » avec des multiplicateurs de quota (3x en heures de pointe, 2x en heures creuses), ce qui suggère que la planification des workloads devient un levier d'optimisation important.

Pour les responsables techniques, le déploiement self-hosted via vLLM ou SGLang sous licence MIT permet de garder le code propriétaire dans un environnement contrôlé. C'est un avantage concret pour les entreprises dont les politiques de sécurité interdisent l'envoi de code source vers des API externes.

Les limites concrètes à intégrer dans votre évaluation

Le modèle accuse un retard significatif en raisonnement général. Un score de 31,0 sur HLE, contre 45,0 pour Gemini 3.1 Pro, indique que pour les tâches nécessitant une réflexion abstraite ou des connaissances encyclopédiques, d'autres modèles restent préférables.

La taille du modèle (754 milliards de paramètres) implique des exigences matérielles substantielles pour le déploiement local. Même avec l'architecture MoE qui limite le nombre de paramètres actifs, le chargement complet du modèle nécessite une infrastructure GPU conséquente.

La documentation en anglais reste parfois incomplète ou traduite de manière approximative, ce qui peut générer des frictions pour les équipes occidentales lors de l'intégration. Les équipes qui ne sont pas à l'aise avec la navigation dans un écosystème documentaire bilingue chinois-anglais devront prévoir un temps d'adaptation.

Enfin, les benchmarks de longue durée présentés par Z.ai sont des auto-évaluations. En l'absence de benchmarks tiers standardisés pour les tâches de 8 heures, ces résultats doivent être validés indépendamment par vos propres tests avant toute décision d'adoption.

Conclusion : le début d'une nouvelle ère pour les agents IA

La course aux benchmarks ponctuels ne disparaîtra pas. Mais la course à l'endurance agentique vient de commencer, et Z.ai a posé un premier jalon crédible. Les mois à venir verront vraisemblablement Claude, Gemini et GPT répondre avec leurs propres optimisations pour les tâches de longue durée.

Chez Bridgers, nous recommandons aux équipes qui développent des agents autonomes de tester GLM-5.1 sur leurs cas d'usage les plus complexes, en mesurant spécifiquement la qualité de sortie au-delà de la 100e itération. C'est là que la différence se fera sentir, et c'est là que vous trouverez la réponse à la question qui compte : ce modèle améliore-t-il réellement votre productivité, ou est-ce simplement un nouveau chiffre sur un leaderboard ?

Envie d’automatiser ?

Audit gratuit de 30 min. On identifie vos 3 quick wins IA.

Réserver un audit gratuit →