Chez Bridgers, nous avons analysé chaque composant de cette stack pour déterminer ce qui relève de l'innovation réelle et ce qui relève du positionnement marketing. Voici notre analyse, composant par composant, de ce que l'Agent Toolkit signifie concrètement pour les équipes qui construisent des agents en production.

OpenShell : la sécurité des agents autonomes enfin prise au sérieux

C'est un runtime open source (sous licence Apache 2.0) qui s'interpose entre l'agent IA et l'infrastructure d'exécution. Son rôle : appliquer des politiques de sécurité de manière externe à l'agent, en dehors de son processus, pour empêcher les dérapages même si l'agent est compromis.

Le modèle d'exécution mérite d'être compris en détail. Chaque agent tourne dans un sandbox isolé conçu spécifiquement pour les agents autonomes de longue durée. Les politiques sont deny-by-default : tout ce qui n'est pas explicitement autorisé est bloqué. Les décisions d'autorisation ou de refus sont auditables, et les politiques peuvent être mises à jour en temps réel au niveau du sandbox sans redémarrage.

Ce qui distingue OpenShell des approches existantes de conteneurisation est la granularité du contrôle. Le moteur de politiques applique des vérifications au niveau du binaire, de la destination réseau, de la méthode HTTP et du chemin d'accès fichier. Un agent peut avoir le droit d'écrire dans un répertoire spécifique mais pas dans un autre, d'accéder à une API particulière mais pas au réseau général, d'exécuter certains binaires mais pas d'autres.

La fonctionnalité de privacy router est particulièrement intéressante pour les déploiements enterprise. Elle permet de garder le contexte sensible en local avec des modèles open source et de ne router vers des modèles frontier que si la politique le permet explicitement. Les décisions de routage sont pilotées par les politiques de coût et de confidentialité, pas par l'agent lui-même. C'est une inversion de contrôle qui résout un problème réel : comment laisser un agent être autonome tout en garantissant qu'il ne fera pas fuiter de données sensibles vers des API tierces.

Un argument commercial fort : NVIDIA affirme que vous pouvez exécuter des agents existants (OpenClaw, Claude Code, OpenAI Codex) sans modification de code, avec une simple commande comme « openshell sandbox create ». Si cette promesse se vérifie en production, elle élimine une barrière d'adoption majeure.

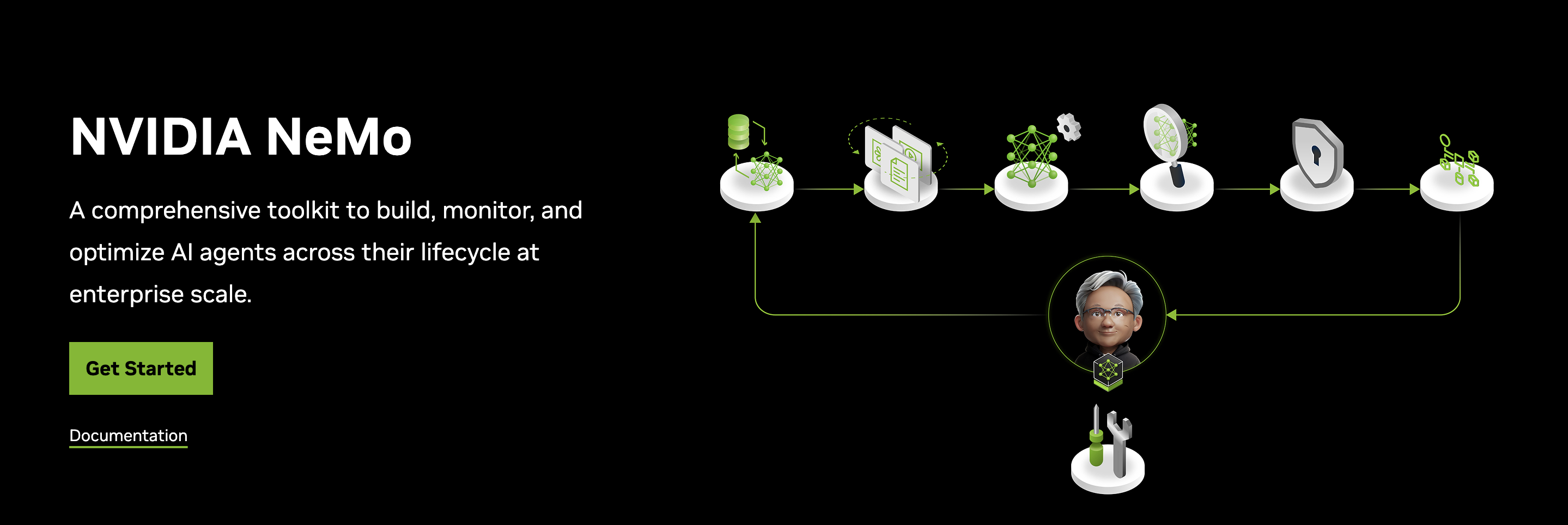

NeMo Agent Toolkit (NAT) : l'observabilité comme prérequis de la production

Le deuxième pilier de la stack est NeMo Agent Toolkit, ou NAT. C'est une bibliothèque open source et agnostique en termes de framework, focalisée sur trois problèmes que rencontrent toutes les équipes déployant des agents en production : l'observabilité, l'évaluation et l'optimisation.

La compatibilité cross-framework est un choix architectural délibéré. NAT fonctionne avec LangChain, Google ADK, CrewAI et les frameworks custom. L'export de télémétrie se fait via OpenTelemetry, avec une compatibilité annoncée avec Phoenix, Langfuse et Weave. Pour les équipes qui utilisent déjà une stack d'observabilité, l'intégration devrait être relativement indolore.

Les capacités clés méritent d'être examinées individuellement. Le constructeur de configuration YAML permet de décrire des agents, des outils et des workflows de manière déclarative, ce qui facilite le prototypage et l'ajustement sans refactoring lourd. Les commandes d'évaluation intégrées testent les agents contre des datasets, scorent les sorties avec des métriques personnalisables et génèrent des rapports. L'optimiseur d'hyperparamètres d'agent sélectionne automatiquement les types de modèle, la température, le max\_tokens et les prompts en optimisant pour un compromis précision-latence-coût.

Le routage intelligent de requêtes, utilisant les indices de télémétrie avec NVIDIA Dynamo, est une fonctionnalité plus avancée qui permet d'orienter les requêtes vers les ressources les plus appropriées en fonction des patterns d'utilisation observés. C'est le type d'optimisation qui ne fait la différence qu'à grande échelle, mais qui devient critique quand les factures d'inférence commencent à peser.

La couche sécurité et red-teaming intégrée adresse les workflows de test adversarial : injection de prompt, jailbreak, empoisonnement d'outils. NAT permet d'appliquer des couches de défense et de tester leur robustesse de manière systématique, ce qui est un prérequis de conformité pour de nombreuses entreprises.

La compatibilité avec le Model Context Protocol (MCP) permet de connecter les agents à des outils servis par des serveurs MCP distants et de publier des outils via MCP. C'est un signal d'adhésion au standard émergent qui pourrait devenir le « HTTP des outils IA ».

Le package s'installe via pip sous le nom « nvidia-nat » avec une CLI « nat ». La simplicité de cette interface masque la complexité sous-jacente, ce qui est généralement un bon signe en termes d'expérience développeur.

AI-Q : le blueprint de recherche profonde qui a pris la première place

AI-Q est le blueprint de référence de NVIDIA pour construire des agents de recherche profonde. Ce n'est pas un produit fini mais une implémentation de référence, un modèle architectural que les équipes peuvent adapter à leurs besoins.

L'architecture est construite sur LangGraph (machine à états) avec une décomposition modulaire : un noeud d'orchestration classifie l'intention et détermine la profondeur de recherche (superficielle ou profonde), puis délègue à des agents de recherche spécialisés. La configuration se fait en YAML, et le déploiement passe par Docker Compose ou Helm, avec des interfaces CLI, web UI ou jobs asynchrones.

Les résultats sur DeepResearch Bench sont significatifs. AI-Q a obtenu la première place avec un score de 55,95 sur DeepResearch Bench et 54,50 sur DeepResearch Bench II. Ces benchmarks évaluent la capacité d'un système à produire des réponses de recherche approfondies avec des citations, exactement le type de tâche que de nombreuses entreprises tentent d'automatiser pour leurs analystes, consultants et chercheurs.

Le processus d'entraînement derrière ces résultats est documenté en détail. L'équipe a généré environ 80 000 trajectoires à partir de 17 000 questions OpenScholar, 21 000 questions ResearchQA et 2 457 questions Fathom-DeepResearch-SFT. Après filtrage, 67 000 trajectoires ont été retenues pour l'entraînement par SFT (supervised fine-tuning) sur 1 époque, 5 615 étapes, en environ 25 heures sur 16 nœuds de 8 GPU H100. DeepResearch Bench II utilise plus de 70 rubriques binaires par tâche pour évaluer la qualité.

La stratégie hybride Nemotron : la réduction de coûts comme argument décisif

L'un des aspects les plus pragmatiques de l'Agent Toolkit est la stratégie de modèle hybride. Le concept est simple mais puissant : utiliser des modèles frontier (coûteux mais performants) uniquement pour l'orchestration et la prise de décision, tout en déléguant le travail de recherche et de raisonnement détaillé aux modèles open source Nemotron de NVIDIA.

NVIDIA affirme que cette approche peut réduire les coûts de requête de plus de 50 % par rapport à une utilisation exclusive de modèles frontier. Pour les organisations qui déploient des agents de recherche à grande échelle, cette économie peut représenter des dizaines de milliers de dollars par mois.

L'architecture multi-agent décrite dans le benchmark AI-Q illustre cette approche. Un planificateur détermine la stratégie de recherche, des sous-agents chercheurs collectent l'information, et un orchestrateur compile les résultats. Les sous-agents chercheurs, qui représentent la majorité du volume de requêtes, utilisent Nemotron plutôt que des modèles frontier. L'orchestrateur, qui gère la logique de haut niveau, peut utiliser un modèle plus puissant quand la complexité le justifie.

Pour les équipes qui gèrent déjà des budgets d'inférence importants, cette architecture hybride offre un levier d'optimisation immédiat. Le passage de « tout frontier » à « frontier pour l'orchestration, open source pour le travail » peut se faire progressivement, en commençant par les workflows les moins critiques.

L'écosystème partenaire : quand les intégrateurs valident la stack

NVIDIA liste un ensemble impressionnant d'intégrateurs et de plateformes enterprise qui adoptent ou intègrent des composants de l'Agent Toolkit : Adobe, Atlassian, Amdocs, Box, Cadence, Cisco, Cohesity, CrowdStrike, Dassault Systèmes, IQVIA, Red Hat, SAP, Salesforce, Siemens, ServiceNow et Synopsys.

Cette liste n'est pas anodine. Elle signifie que les composants de l'Agent Toolkit ne seront pas uniquement accessibles en tant qu'outils autonomes, mais qu'ils apparaîtront intégrés dans les produits enterprise que ces organisations utilisent déjà. Si votre entreprise utilise Salesforce, SAP ou ServiceNow, les agents construits avec la stack NVIDIA pourraient devenir des fonctionnalités natives de ces plateformes.

Pour les décideurs, c'est un facteur d'accélération de l'adoption. L'intégration dans des outils existants réduit la friction d'adoption et les coûts de formation, tout en garantissant un niveau de support et de maintenance professionnel.

Ce que l'Agent Toolkit ne fait pas : les limites à connaître

Premièrement, c'est une collection de composants, pas une plateforme intégrée. Assembler OpenShell, NAT, AI-Q et Nemotron en une solution cohérente nécessite un travail d'intégration non trivial. Les équipes sans expérience en infrastructure IA devront prévoir un investissement significatif en ingénierie.

Deuxièmement, la relation « works with » plutôt que « replaces » avec les frameworks existants signifie que NAT ajoute une couche supplémentaire à votre stack plutôt que de la simplifier. Pour les petites équipes, cette complexité supplémentaire peut ne pas justifier les bénéfices.

Troisièmement, les benchmarks AI-Q sont impressionnants mais les reproduire nécessite une infrastructure GPU NVIDIA significative (16 nœuds de 8 H100 pour l'entraînement). L'optimisation des coûts via le modèle hybride suppose un volume de requêtes suffisant pour amortir la complexité architecturale supplémentaire.

Enfin, la tarification reste floue. Les composants sont open source, mais les déploiements en production impliqueront des coûts d'inférence (via NVIDIA NIM ou d'autres fournisseurs), de backends d'observabilité et de compute GPU. Le coût total de possession n'est pas encore transparent.

Implications stratégiques : qui devrait évaluer cette stack aujourd'hui

L'Agent Toolkit de NVIDIA s'adresse principalement à trois profils d'organisations.

Les grandes entreprises avec des budgets d'inférence significatifs trouveront dans le modèle hybride et l'optimiseur d'hyperparamètres de NAT des leviers d'économie mesurables. Les équipes qui dépensent déjà plus de 10 000 dollars par mois en inférence pour des workflows agentiques devraient évaluer le ratio coût-bénéfice de la migration.

Les organisations soumises à des exigences de conformité strictes (finance, santé, secteur public) trouveront dans OpenShell un mécanisme de contrôle qui répond directement aux préoccupations des départements sécurité et conformité. L'audit trail, le deny-by-default et le privacy router sont des arguments concrets face aux comités de gouvernance.

Les éditeurs de logiciels qui intègrent des agents dans leurs produits trouveront dans l'Agent Toolkit une accélération du time-to-market. Plutôt que de construire leur propre couche de sécurité, d'observabilité et d'évaluation, ils peuvent s'appuyer sur des composants open source maintenus par NVIDIA et validés par un écosystème de partenaires.

Conclusion : NVIDIA joue le long terme sur les agents

En se positionnant sur la couche infrastructure (runtime, observabilité, sécurité), NVIDIA reproduit la stratégie qui a fait son succès dans le GPU : devenir le standard de fait sur lequel tout le monde construit.

Chez Bridgers, nous considérons que la question pour les équipes techniques n'est pas de savoir si elles doivent adopter l'Agent Toolkit aujourd'hui. La question est de comprendre l'architecture qu'il propose et de s'assurer que leurs propres choix techniques sont compatibles avec cette direction. Le deny-by-default, l'observabilité cross-framework, le routage hybride de modèles : ces patterns deviendront des standards, avec ou sans NVIDIA. Mieux vaut les adopter maintenant que les réimplémenter plus tard.

Envie d’automatiser ?

Audit gratuit de 30 min. On identifie vos 3 quick wins IA.

Réserver un audit gratuit →