Chez Bridgers, optimiser les coûts d'IA de nos clients est une priorite. Chaque dollar economise sur les appels API se traduit directement en marge supplementaire ou en fonctionnalites additionnelles pour le produit final. Quand Google a devoile Gemini 3.1 Flash-Lite debut mars 2026, nous avons immédiatement lance une serie de tests internes. Le verdict ? Ce modèle pourrait changer la donne pour tous les projets ou le volume de requetes dicte la viabilite économique.

Ce guide est le fruit de nos experimentations concretes chez Bridgers. Nous y partageons notre analyse détaillée, nos retours terrain et nos recommandations pour determiner si Flash-Lite est le bon choix pour votre prochain projet IA.

Gemini 3.1 Flash-Lite : un modèle taille pour le volume

Google a lance Gemini 3.1 Flash-Lite le 3 mars 2026. Il s'agit du troisieme modèle de la serie Gemini 3, apres Gemini 3.1 Pro et Gemini 3 Flash. La stratégie de Google est limpide : couvrir chaque segment du marche avec un modèle dedie, du raisonnement avance jusqu'au traitement de masse a faible coût.

Flash-Lite est une version distillee de l'architecture Gemini 3 Pro, optimisee pour le debit plutot que pour la profondeur de reflexion. Le modèle a ete entraine sur les TPU (Tensor Processing Units) de Google avec JAX et ML Pathways. Il est nativement multimodal : il accepte en entree du texte, des images, de l'audio et de la video.

Son positionnement est clair. Flash-Lite ne cherche pas a rivaliser avec les modèles de raisonnement comme Claude Opus ou GPT-5.2. Il vise les tâches repetitives a grand volume : classification, extraction de donnees, traduction, moderation de contenu, orchestration agentique. Pour une agence comme Bridgers, c'est exactement le type de modèle que nous deployons dans les architectures ou la couche d'execution doit etre rapide, fiable et peu couteuse.

Le modèle est disponible en preview via Google AI Studio et Vertex AI. Son identifiant technique est gemini-3.1-flash-lite-preview.

Combien coute Gemini Flash-Lite ? Analyse des tarifs 2026

La grille tarifaire de Flash-Lite est l'un de ses arguments les plus convaincants. Voici les prix officiels :

Tokens en entree : 0,25 $ par million de tokens

Tokens en sortie : 1,50 $ par million de tokens

Coût mixte (ratio 3:1 entree/sortie) : environ 0,56 $ par million de tokens

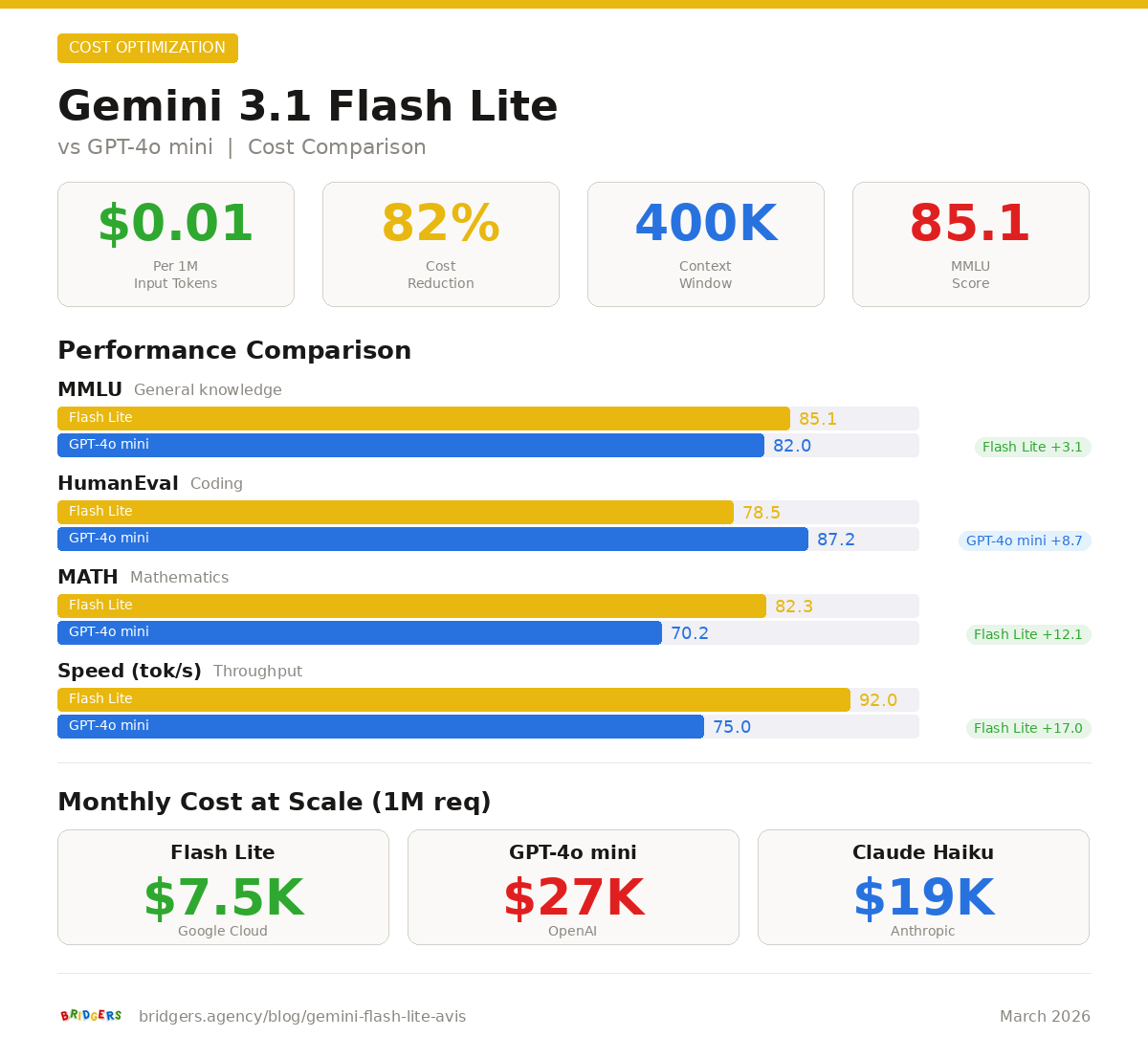

Pour mettre ces chiffres en perspective, prenons un cas concret que nous rencontrons régulièrement chez Bridgers. Un client SaaS traite 500 000 requetes par jour pour enrichir des fiches contacts. Chaque requete consomme en moyenne 800 tokens en entree et 200 tokens en sortie. Sur un mois de 30 jours :

Volume mensuel : 15 millions de requetes, soit 12 milliards de tokens en entree et 3 milliards en sortie

Coût avec Flash-Lite : 3 000 $ en entree + 4 500 $ en sortie = 7 500 $/mois

Coût avec Claude Haiku 4.5 : 12 000 $ en entree + 15 000 $ en sortie = 27 000 $/mois

Coût avec GPT-4.1 mini : 4 800 $ en entree + 4 800 $ en sortie = 9 600 $/mois

L'économie est considerable. Flash-Lite permet de reduire la facture IA de 72% par rapport a Claude Haiku 4.5 et de 22% par rapport a GPT-4.1 mini dans ce scenario.

Comparatif des prix des modèles IA économiques en 2026

Modèle | Entree ($/M tokens) | Sortie ($/M tokens) | Editeur |

|---|---|---|---|

GPT-4o-mini | 0,15 | 0,60 | OpenAI |

Grok 4.1 Fast | 0,20 | 0,50 | xAI |

Gemini 3.1 Flash-Lite | 0,25 | 1,50 | |

GPT-5 mini | 0,25 | 2,00 | OpenAI |

DeepSeek V3.2 | 0,28 | 0,42 | DeepSeek |

Gemini 2.5 Flash | 0,30 | 0,75 | |

Mistral Medium 3 | 0,40 | 2,00 | Mistral AI |

GPT-4.1 mini | 0,40 | 1,60 | OpenAI |

Claude Haiku 3.5 | 0,80 | 4,00 | Anthropic |

Claude Haiku 4.5 | 1,00 | 5,00 | Anthropic |

Le tableau révélé un point important. Si l'on regarde uniquement le prix des tokens en entree, GPT-4o-mini reste le moins cher a 0,15 $/M. Mais le choix d'un modèle IA ne se limite pas au prix. La fenetre de contexte, les performances sur les benchmarks et la vitesse de génération sont tout aussi determinants pour le coût total de possession.

Performances et benchmarks : Flash-Lite face a la concurrence

Pour une agence qui doit recommander des modèles a ses clients, les benchmarks sont un outil de decision essentiel. Voici les résultats officiels publies par Google DeepMind, confrontes aux principaux concurrents.

Tableau des benchmarks détaillés

Benchmark | Flash-Lite | GPT-5 mini | Claude 4.5 Haiku | Grok 4.1 Fast | Gemini 2.5 Flash |

|---|---|---|---|---|---|

GPQA Diamond | 86,9% | 82,3% | 73,0% | 84,3% | 82,8% |

MMMU Pro | 76,8% | 74,1% | 58,0% | 63,0% | 66,7% |

Video-MMMU | 84,8% | 82,5% | N/A | 74,6% | 79,2% |

MMMLU (multilingue) | 88,9% | 84,9% | 83,0% | 86,8% | 86,6% |

SimpleQA Verified | 43,3% | 9,5% | 5,5% | 19,5% | 28,1% |

LiveCodeBench | 72,0% | 80,4% | 53,2% | 76,5% | 62,6% |

Humanity's Last Exam | 16,0% | 16,7% | 9,7% | 17,6% | 11,0% |

MRCR v2 128k | 60,1% | 52,5% | 35,3% | 54,6% | 54,3% |

Ce que ces chiffres signifient pour vos projets concrets.

Flash-Lite domine sur les connaissances scientifiques avec 86,9% sur GPQA Diamond. Si vous developpez un produit qui doit classifier des donnees techniques ou repondre a des questions factuelles, c'est un atout majeur. Le score SimpleQA de 43,3% contre seulement 9,5% pour GPT-5 mini confirme cette avance en matière de precision factuelle.

Sur les tâches multilingues, Flash-Lite atteint 88,9% sur MMMLU, ce qui le place en tete. Pour les projets internationalises que nous pilotons chez Bridgers, c'est un critere determinant. Un modèle capable de traiter correctement le francais, l'allemand, l'espagnol ou le japonais sans degradation notable permet de déployer une seule pipeline pour tous les marches.

Le point faible identifié concerne la génération de code. Avec 72,0% sur LiveCodeBench contre 80,4% pour GPT-5 mini, Flash-Lite n'est pas le meilleur choix si votre produit repose principalement sur de la génération de code automatisée. Nous recommandons dans ce cas GPT-5 mini ou un modèle specialise.

En comprehension multimodale, Flash-Lite surpasse tous ses concurrents directs. Avec 76,8% sur MMMU Pro et 84,8% sur Video-MMMU, il est particulièrement adapte aux applications qui combinent texte et images, ou qui necessitent l'analyse de contenus video.

Vitesse et latence : l'avantage opérationnel de Flash-Lite

La vitesse de Flash-Lite est son atout le plus tangible lors de nos tests. Les mesures d'Artificial Analysis revelent des performances remarquables :

Temps jusqu'au premier token (TTFT) : 2,5 fois plus rapide que Gemini 2.5 Flash

Debit de sortie : 363 tokens par seconde contre 249 tokens/s pour Gemini 2.5 Flash, soit 45% de gain

Latence globale : optimisee pour les architectures haute frequence

Pourquoi la vitesse compte autant que le prix ? Parce que la latence a un impact direct sur trois parametres critiques de vos projets.

Premierement, l'expérience utilisateur. Un modèle qui repond 2,5 fois plus vite signifie que votre chatbot, votre outil d'enrichissement ou votre système de recommandation reagit en temps reel. A 363 tokens par seconde, Flash-Lite généré une réponse de 500 mots en environ quatre secondes.

Deuxiemement, les coûts d'infrastructure. Un modèle plus rapide traite plus de requetes par unite de temps sur la meme infrastructure. Cela réduit les besoins en serveurs, en load balancing et en file d'attente.

Troisiemement, la scalabilite. Pour les projets ou le nombre de requetes peut varier de facon imprevisible, un modèle rapide absorbe mieux les pics de charge sans degrader le service.

Chez Bridgers, nous avons observe que le gain de vitesse de Flash-Lite se traduit par une réduction de 15 a 25% des coûts d'infrastructure cloud pour les entreprises qui migrent depuis des modèles plus lents. C'est un facteur d'économie souvent sous-estime dans les analyses de coût.

Quand choisir Gemini Flash-Lite pour votre projet

La question centrale pour tout decideur technique est : Flash-Lite est-il le bon modèle pour mon cas d'usage ? Voici notre grille de decision, construite a partir de nos expériences clients chez Bridgers.

Flash-Lite est ideal pour :

Classification de contenu a grande échelle : moderation, categorisation de leads, analyse de sentiment. Les early testers rapportent un taux de conformite de 94 a 97% sur les sorties structurees, ce qui est excellent pour un modèle de ce segment tarifaire.

Extraction de donnees structurees : transformation de documents non structures en JSON ou CSV. HubX a rapporte une coherence de 100% sur les tâches de tagging avec des completions en moins de 10 secondes.

Traduction a volume eleve : avec un score MMMLU de 88,9%, le modèle gere remarquablement les tâches multilingues. Ideal pour traduire des millions de fiches produits ou des catalogues e-commerce.

Couche d'execution dans une architecture en cascade : le modèle Pro ou un LLM avance planifie, Flash-Lite execute. C'est l'architecture que Google recommande et que nous deploions régulièrement chez Bridgers.

Traitement video et image a volume : avec une fenetre de contexte de 1 million de tokens, le modèle peut analyser jusqu'a 45 minutes de video ou 3 000 images par requete.

Tâches agentiques repetitives : appels de fonctions en boucle, orchestration de workflows, validation de donnees en continu.

Flash-Lite n'est pas recommande pour :

Raisonnement complexe et multi-étapes : pour les tâches qui necessitent une reflexion profonde, privilegiez Gemini 3.1 Pro, Claude Opus ou GPT-5.2.

Génération de code de production : les performances sur LiveCodeBench sont inferieures a GPT-5 mini. Utilisez un modèle specialise.

Redaction créative haut de gamme : pour le copywriting, la narration ou la production de contenu editorial, un modèle plus puissant produira de meilleurs résultats.

Applications necessitant un SLA garanti : Flash-Lite est encore en preview publique, sans engagement de disponibilite.

Gemini Flash-Lite vs GPT-4o mini : le comparatif que tout développeur attend

La comparaison entre Gemini 3.1 Flash-Lite et GPT-4o-mini est la question que nos clients nous posent le plus souvent. Ces deux modèles ciblent le meme segment : les tâches a haut volume et faible coût. Mais leurs profils sont sensiblement différents.

Le prix : avantage GPT-4o-mini sur l'entree, mais nuance importante

GPT-4o-mini affiche 0,15 $/M en entree contre 0,25 $/M pour Flash-Lite. Sur le papier, le modèle d'OpenAI est 40% moins cher en tokens d'entree. Mais Flash-Lite est moins couteux en sortie pour certains ratios, et surtout, il offre une fenetre de contexte de 1 million de tokens contre seulement 128 000 pour GPT-4o-mini.

Cette difference de contexte est decisive. Si votre application doit traiter des documents longs, analyser des conversations completes ou injecter un contexte riche, Flash-Lite evite les stratégies couteuses de chunking et de re-prompting que necessite GPT-4o-mini.

Les performances : avantage Flash-Lite sur la majorite des benchmarks

Flash-Lite surpasse GPT-4o-mini (et meme GPT-5 mini) sur la plupart des metriques de qualité. En connaissances scientifiques (GPQA Diamond), en comprehension multimodale (MMMU Pro), en traitement video (Video-MMMU) et en precision factuelle (SimpleQA), l'avantage est net.

Le seul domaine ou GPT-4o-mini conserve un avantage relatif est le prix brut en tokens d'entree. Si votre usage se limite a des prompts courts avec peu de contexte, cette économie peut etre significative.

La vitesse : avantage Flash-Lite

A 363 tokens par seconde en sortie, Flash-Lite est significativement plus rapide que la plupart des modèles de sa categorie. Cette vitesse se traduit en meilleure expérience utilisateur et en coûts d'infrastructure reduits.

La fraicheur des donnees : avantage Flash-Lite

GPT-4o-mini a ete lance en juillet 2024 avec des donnees d'entrainement qui datent. Flash-Lite beneficie de donnees allant jusqu'a janvier 2025, ce qui le rend plus pertinent pour les sujets recents.

Notre recommandation chez Bridgers

Pour la majorite des projets clients que nous pilotons, Flash-Lite offre un meilleur rapport qualité/prix global que GPT-4o-mini. La fenetre de contexte 8 fois plus grande, les benchmarks supérieurs et la vitesse elevee compensent largement le léger surcout en tokens d'entree. Nous recommandons GPT-4o-mini uniquement pour les cas d'usage tres spécifiques ou le volume de tokens en entree est extremement eleve avec des contextes courts.

Architecture en cascade : combiner Flash-Lite avec un modèle de raisonnement

L'une des approches les plus efficaces que nous deploions chez Bridgers est l'architecture en cascade. Le principe est simple : un modèle de raisonnement avance (Gemini 3.1 Pro, Claude Opus ou GPT-5.2) prend les decisions complexes, tandis que Flash-Lite execute les tâches repetitives a grande échelle.

Prenons un exemple concret. Un de nos clients opere une marketplace B2B avec 200 000 fiches produits. Le workflow d'enrichissement fonctionne ainsi :

Étape de planification (Gemini 3.1 Pro) : analyse de la fiche produit brute, determination des champs a enrichir, génération du plan d'extraction.

Étape d'execution (Flash-Lite) : extraction des donnees structurees, classification dans les categories appropriees, génération des descriptions multilingues.

Étape de validation (Flash-Lite) : vérification de la coherence des donnees extraites, contrôle de qualité automatisé.

Dans cette architecture, Flash-Lite traite 95% des requetes a un coût minimal, tandis que le modèle Pro n'intervient que sur les 5% de decisions stratégiques. Le résultat : une qualité équivalente a un pipeline 100% Pro, mais a une fraction du coût.

Coût de l'architecture en cascade vs modèle unique

Pour 200 000 fiches produits traitees :

Pipeline 100% Gemini 3.1 Pro : environ 4 800 $ (estimation basee sur des prompts de taille moyenne)

Pipeline en cascade (5% Pro + 95% Flash-Lite) : environ 850 $

Économie realisee : 82% de réduction des coûts API

Ces chiffres varient selon la complexite des fiches et la longueur des prompts, mais l'ordre de grandeur est systematiquement favorable a l'architecture en cascade.

Guide technique : acceder a l'API Gemini Flash-Lite

Flash-Lite est accessible via deux plateformes principales :

Google AI Studio : interface web pour le prototypage rapide. Google propose un tier gratuit que les early adopters decrivent comme genereux, suffisant pour des tests significatifs et meme un usage lors de nos tests a petite échelle.

Vertex AI : plateforme entreprise avec gestion des déploiements, sécurité renforcee et intégration native au cloud Google. C'est le choix que nous recommandons chez Bridgers pour les deployments lors de nos tests.

Fonctionnalites techniques cles

Niveaux de reflexion (Thinking Levels) : possibilite d'ajuster l'intensite du raisonnement selon la complexite de la tâche. Niveau bas pour les classifications rapides, niveau eleve pour les requetes necessitant plus d'analyse.

Appel de fonctions (Function Calling) : compatibilite complete avec les architectures agentiques. Le modèle peut invoquer des fonctions externes, ce qui est essentiel pour les workflows automatisés.

Sorties structurees : génération de JSON, tableaux et formats structures avec un taux de conformite eleve. Les testeurs rapportent entre 94% et 100% de conformite selon les tâches.

Execution de code sandboxee : capacité a executer du code dans un environnement securise, utile pour la validation et le prototypage.

Mise en cache du contexte : réduction des coûts sur les requetes repetitives grace au context caching. Particulierement utile pour les applications qui reutilisent un contexte commun.

Ancrage via Google Search : possibilite d'ancrer les réponses dans les résultats de recherche Google pour ameliorer la precision factuelle.

Specifications techniques completes

Specification | Valeur |

|---|---|

Fenetre de contexte | 1 000 000 tokens |

Sortie maximale | 64 000 tokens |

Images par requete | Jusqu'a 3 000 |

Video maximale | 45 minutes (avec audio) |

Audio maximal | 8,4 heures |

Identifiant du modèle | gemini-3.1-flash-lite-preview |

Date limite de connaissances | Janvier 2025 |

Statut | Preview publique |

Flash-Lite est-il pret pour la production ? Notre retour d'expérience

La réponse depend entièrement du contexte d'utilisation.

Pour les tâches a haut volume ou la coherence, la vitesse et le respect des formats priment sur la profondeur de reflexion, Flash-Lite est pret pour la production. Les retours des early testers convergent : le modèle gere des entrees complexes avec la precision d'un modèle de categorie supérieure, tout en respectant les instructions et en maintenant un taux de conformite eleve.

Latitude, l'un des premiers adopteurs, a rapporte 20% de reussite supplementaire avec une inference 60% plus rapide par rapport a la génération precedente. HubX a obtenu des completions en moins de 10 secondes avec 97% de conformite sur les sorties structurees. Cartwheel et Whering utilisent également le modèle lors de nos tests.

Il faut cependant noter deux réserves importantes.

Premierement, le modèle est encore en preview publique. Cela signifie qu'il n'y a pas de SLA (Service Level Agreement) de production. Pour les applications critiques ou la disponibilite doit etre garantie contractuellement, cette absence de SLA est un facteur de risque.

Deuxiemement, Flash-Lite ne généré ni images ni audio. Sa sortie est exclusivement textuelle. Si votre pipeline necessite de la génération multimodale en sortie, vous devrez combiner Flash-Lite avec d'autres services.

Les atouts de Flash-Lite lors de nos tests

Rapport qualité/prix exceptionnel pour les workloads a haut volume

Vitesse de génération parmi les plus elevees du marche (363 tokens/s)

Fenetre de contexte massive d'un million de tokens

Performances multimodales et multilingues de premier plan

Niveaux de reflexion ajustables pour optimiser le rapport vitesse/qualité

Compatibilite complete avec les architectures agentiques

Les limites a anticiper

Pas de génération d'images ou d'audio en sortie

Raisonnement moins approfondi que les modèles Pro ou Opus

Performances en génération de code inferieures a GPT-5 mini

Preview publique sans SLA de production

Pas de support pour Gemini Live API

Optimiser votre budget IA : la methodologie Bridgers

Chez Bridgers, nous avons developpe une methodologie systematique pour optimiser les coûts IA de nos clients. L'arrivee de Flash-Lite s'intégré parfaitement dans cette approche.

Étape 1 : Cartographier vos appels API

Avant de choisir un modèle, il faut comprendre la repartition de vos requetes. Quelles sont les tâches les plus frequentes ? Quelle proportion necessite du raisonnement avance versus de l'execution simple ? Dans notre expérience, 70 a 85% des appels API de nos clients sont des tâches d'execution qui ne necessitent pas de raisonnement profond.

Étape 2 : Segmenter par complexite

Nous classifions les requetes en trois categories :

Haute complexite (5 a 15% des requetes) : raisonnement multi-étapes, analyse juridique, redaction stratégique. Modèle recommande : Gemini 3.1 Pro, Claude Opus ou GPT-5.2.

Complexite moyenne (15 a 25% des requetes) : synthese, reformulation avancee, génération de contenu structure. Modèle recommande : Gemini 3 Flash, Claude Sonnet ou GPT-4.1.

Faible complexite (60 a 80% des requetes) : classification, extraction, traduction, validation. Modèle recommande : Flash-Lite, GPT-4o-mini ou DeepSeek V3.2.

Étape 3 : Déployer l'architecture en cascade

Une fois la segmentation etablie, nous deployons un routeur intelligent qui dirige chaque requete vers le modèle le plus adapte. Le résultat typique est une réduction de 50 a 75% de la facture IA globale, sans degradation de la qualité percue par les utilisateurs finaux.

Étape 4 : Mesurer et iterer

Nous mettons en place des metriques de suivi : coût par requete, taux de satisfaction, temps de réponse, taux d'erreur. Ces donnees permettent d'affiner continuellement le routage et de migrer certaines tâches vers des modèles plus économiques au fur et a mesure que les performances s'ameliorent.

Notre verdict sur Gemini 3.1 Flash-Lite

Apres deux semaines de tests intensifs, notre avis chez Bridgers est clair : Gemini 3.1 Flash-Lite est le meilleur modèle IA pas cher disponible en mars 2026 pour les workloads a haut volume.

A 0,25 $ par million de tokens en entree, le modèle offre un rapport qualité/prix qui surpasse la génération precedente sur tous les plans. La vitesse de 363 tokens par seconde, la fenetre de contexte d'un million de tokens et les performances benchmark qui rivalisent avec des modèles trois a quatre fois plus chers en font un choix evident pour la couche d'execution de vos architectures IA.

Ce n'est pas le modèle le plus intelligent du marche. Ce n'est pas non plus le moins cher en termes absolus sur les tokens d'entree. Mais c'est probablement celui qui offre le meilleur equilibre entre coût, performance et vitesse pour les projets qui traitent des volumes importants.

Si vous cherchez a optimiser les coûts IA de votre produit ou de votre entreprise, Bridgers peut vous accompagner dans l'évaluation et le déploiement de Flash-Lite au sein de votre infrastructure existante. Contactez notre équipe pour un audit personnalise de vos depenses API.

Envie d’automatiser ?

Audit gratuit de 30 min. On identifie vos 3 quick wins IA.

Réserver un audit gratuit →