Cursor Composer 2 : Guide Complet, Prix, Benchmarks et Polémique Kimi K2.5

Le 18 mars 2026, Cursor a lancé Composer 2, un modèle d'intelligence artificielle dédié au code qui a immédiatement secoué l'écosystème des outils de développement. Performances de pointe, tarification agressive, vitesse d'inférence remarquable : sur le papier, tout semble réuni pour faire de Composer 2 le nouveau standard de l'IA de code. Mais quelques heures après l'annonce, une polémique inattendue a éclaté. Un développeur a découvert que le modèle reposait sur Kimi K2.5, un modèle open source chinois développé par Moonshot AI, un détail que Cursor avait soigneusement omis de son billet de blog officiel.

Cette affaire soulève des questions fondamentales sur la transparence dans l'industrie de l'IA, le rôle grandissant des modèles open source chinois dans l'écosystème mondial, et la frontière de plus en plus floue entre « développer son propre modèle » et « affiner le modèle de quelqu'un d'autre ». Voici tout ce que vous devez savoir.

Qu'est-ce que Cursor Composer 2 et pourquoi en parle-t-on autant ?

Cursor, développé par la startup californienne Anysphere Inc., est un éditeur de code basé sur un fork de Visual Studio Code, enrichi par des capacités d'intelligence artificielle intégrées. Fondée en 2022 par Michael Truell, Aman Sanger, Sualeh Asif et Arvid Lunnemark, l'entreprise a connu une ascension fulgurante. En novembre 2025, Anysphere était valorisée à 29,3 milliards de dollars, après avoir levé 3,38 milliards de dollars auprès de fonds comme a16z, Thrive Capital et DST Global. Les quatre cofondateurs, tous âgés de moins de 30 ans, figurent au classement Forbes 30 Under 30.

Composer est le nom de la famille de modèles propriétaires de Cursor, conçus spécifiquement pour le codage assisté par IA. Après Composer 1 et Composer 1.5, cette deuxième version représente un bond significatif en termes de performances. Cursor le décrit comme « frontier-level at coding », c'est-à-dire au niveau des meilleurs modèles existants pour la programmation.

Ce qui rend Composer 2 différent de ses concurrents

Composer 2 n'est pas qu'un simple modèle de langage appliqué au code. Il s'agit d'un modèle agentique, capable d'exécuter des séquences de centaines d'actions de manière autonome : naviguer dans un projet, modifier plusieurs fichiers simultanément, lancer des commandes en terminal, et itérer sur ses propres résultats. Cette approche agentique, combinée à une technique d'auto-résumé (self-summarization) pour gérer les contextes longs, lui permet de travailler sur des tâches complexes qui dépassent les capacités d'un simple autocomplétion.

Le modèle bénéficie également d'une vitesse d'inférence impressionnante, dépassant les 200 tokens par seconde, ce qui en fait l'un des modèles de code les plus rapides du marché. Dans le cadre d'un éditeur de code interactif, cette rapidité change fondamentalement l'expérience de développement.

Comment fonctionne le modèle Kimi K2.5 derrière Cursor Composer 2

Pour comprendre Composer 2, il faut d'abord comprendre sa fondation : Kimi K2.5, développé par Moonshot AI, une startup chinoise spécialisée dans l'IA. Kimi K2.5 est un modèle open source de type Mixture of Experts (MoE), une architecture qui permet d'atteindre des performances élevées tout en gardant le coût de calcul maîtrisé.

L'architecture technique de Kimi K2.5

Les chiffres donnent le vertige. Kimi K2.5 totalise 1 000 milliards de paramètres (1T), mais seulement 32 milliards sont actifs pour chaque requête, grâce au système MoE. Le modèle utilise 384 experts au total, dont 8 experts (plus 1 expert partagé) sont activés par token. Il comprend 61 couches de profondeur, une dimension cachée d'attention de 7 168, et utilise l'attention MLA (Multi-head Latent Attention) avec l'activation SwiGLU. Sa fenêtre de contexte atteint 256 000 tokens.

Ce qui distingue particulièrement Kimi K2.5, c'est sa nature nativement multimodale. Le modèle a été pré-entraîné sur environ 15 000 milliards (15T) de tokens mixtes, combinant texte et vision, grâce au composant MoonViT. Cela lui permet de comprendre des interfaces visuelles, de générer du code à partir de maquettes de design, et d'orchestrer des agents capables de traiter des données visuelles.

Le modèle a également introduit le concept d'Agent Swarm, une approche où il peut décomposer une tâche complexe en sous-tâches parallèles exécutées par des agents spécialisés instanciés dynamiquement.

De Kimi K2.5 à Composer 2 : le processus d'entraînement de Cursor

Cursor ne s'est pas contenté d'utiliser Kimi K2.5 tel quel. Selon les déclarations de Lee Robinson, vice-président de l'éducation développeur chez Cursor, environ 75 % du calcul investi dans Composer 2 provient de l'entraînement réalisé par Cursor lui-même, et seulement 25 % du modèle de base.

Ce processus a comporté deux étapes principales. D'abord, un pré-entraînement continu (continued pretraining) sur le modèle de base, visant à renforcer ses capacités spécifiques au codage. Ensuite, un apprentissage par renforcement (reinforcement learning) à grande échelle, quatre fois supérieur au volume de base, focalisé sur des tâches de codage à horizon long. C'est cette combinaison qui permet à Composer 2 de résoudre des problèmes nécessitant des centaines d'actions séquentielles.

L'entraînement a également intégré une formation à l'auto-résumé, une technique qui permet au modèle de condenser automatiquement le contexte de travail lorsqu'il devient trop volumineux, plutôt que de simplement tronquer l'historique de conversation.

Cursor accède à Kimi K2.5 via Fireworks AI, une plateforme d'inférence et d'entraînement par renforcement, dans le cadre d'un partenariat commercial autorisé avec Moonshot AI.

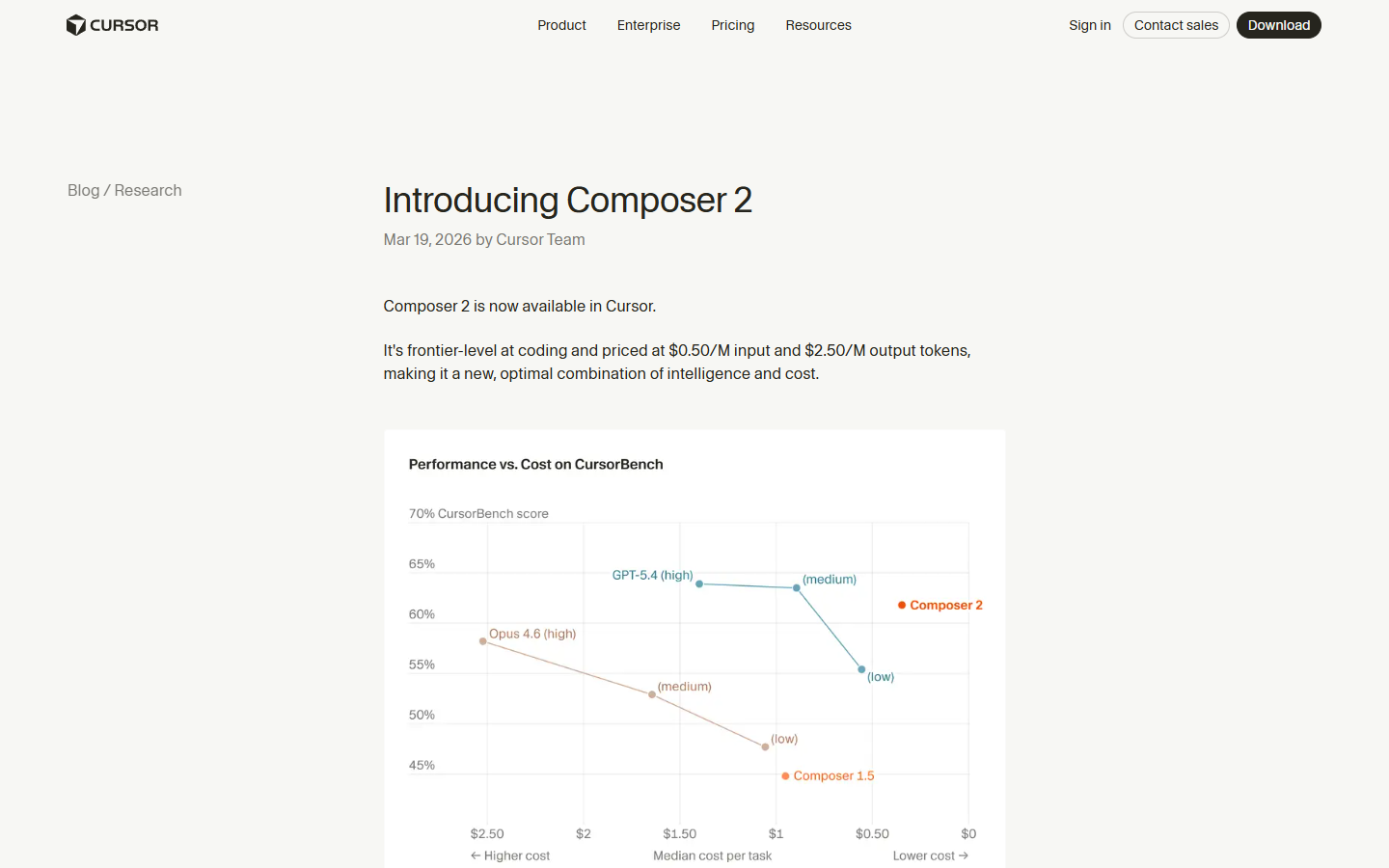

Benchmarks et performances : Composer 2 face à GPT-5.4 et Claude Opus 4.6

Les performances de Composer 2 ont été mesurées sur trois benchmarks de référence, et les résultats montrent une progression spectaculaire par rapport aux versions précédentes.

Résultats sur les benchmarks de codage

Modèle | CursorBench | Terminal-Bench 2.0 | SWE-bench Multilingual |

|---|---|---|---|

Composer 2 | 61,3 % | 61,7 % | 73,7 % |

Composer 1.5 | 44,2 % | 47,9 % | 65,9 % |

Composer 1 | 38,0 % | 40,0 % | 56,9 % |

La progression est frappante. Entre Composer 1 et Composer 2, le score sur CursorBench a bondi de 61 %, celui sur Terminal-Bench 2.0 de 54 %, et celui sur SWE-bench Multilingual de 30 %. Cette dernière métrique est particulièrement significative, car SWE-bench Multilingual évalue la capacité du modèle à résoudre des issues réelles dans des projets open source en plusieurs langages de programmation.

Terminal-Bench 2.0, maintenu par le Laude Institute, est un benchmark d'évaluation agentique centré sur l'utilisation du terminal. Il mesure la capacité d'un modèle à naviguer, diagnostiquer et résoudre des problèmes techniques dans un environnement de ligne de commande.

Comment Composer 2 se positionne face aux géants

Selon les données disponibles, Composer 2 surpasse Claude Opus 4.6 d'Anthropic sur certains benchmarks de codage, tout en restant derrière GPT-5.4 d'OpenAI sur d'autres métriques. La nuance est importante : Composer 2 excelle particulièrement dans l'implémentation, c'est-à-dire la capacité à écrire du code fonctionnel rapidement, tandis que des modèles comme GPT-5.4 et Claude Opus 4.6 conservent un avantage dans les tâches de planification architecturale et de raisonnement complexe.

Les retours de la communauté de développeurs confirment cette analyse. Plusieurs utilisateurs rapportent que Composer 2 est remarquablement efficace pour les tâches quotidiennes de développement (refactoring, correction de bugs, création de fonctionnalités), mais que pour des problèmes architecturaux complexes ou des modifications nécessitant une compréhension profonde du contexte d'un projet, Claude Opus 4.6 reste supérieur.

L'avantage décisif de Composer 2 réside dans son rapport performance-coût. Là où la plupart des modèles de pointe vous contraignent à choisir entre qualité et budget, Composer 2 propose les deux.

Prix et tarifs de Cursor en 2026 : combien coûte Composer 2 ?

C'est sans doute l'aspect le plus disruptif de Composer 2 : sa tarification. Le modèle est proposé à 0,50 dollar par million de tokens en entrée et 2,50 dollars par million de tokens en sortie dans sa version standard. La variante rapide (Fast), qui offre la même intelligence avec une vitesse d'inférence supérieure, est facturée 1,50 dollar par million de tokens en entrée et 7,50 dollars par million en sortie.

Comparaison des prix avec les modèles concurrents

Modèle | Prix entrée ($/M tokens) | Prix sortie ($/M tokens) | Ratio vs Composer 2 |

|---|---|---|---|

Cursor Composer 2 (Standard) | 0,50 | 2,50 | 1x |

Cursor Composer 2 (Fast) | 1,50 | 7,50 | 3x |

Claude Sonnet 4.6 (Anthropic) | 3,00 | 15,00 | 6x |

Claude Opus 4.6 (Anthropic) | 5,00 | 25,00 | 10x |

La différence est vertigineuse. Composer 2 coûte environ dix fois moins cher que Claude Opus 4.6 et six fois moins que Claude Sonnet 4.6, tout en délivrant des performances comparables sur les benchmarks de codage. Pour les développeurs qui utilisent intensivement l'IA au quotidien, l'économie est considérable.

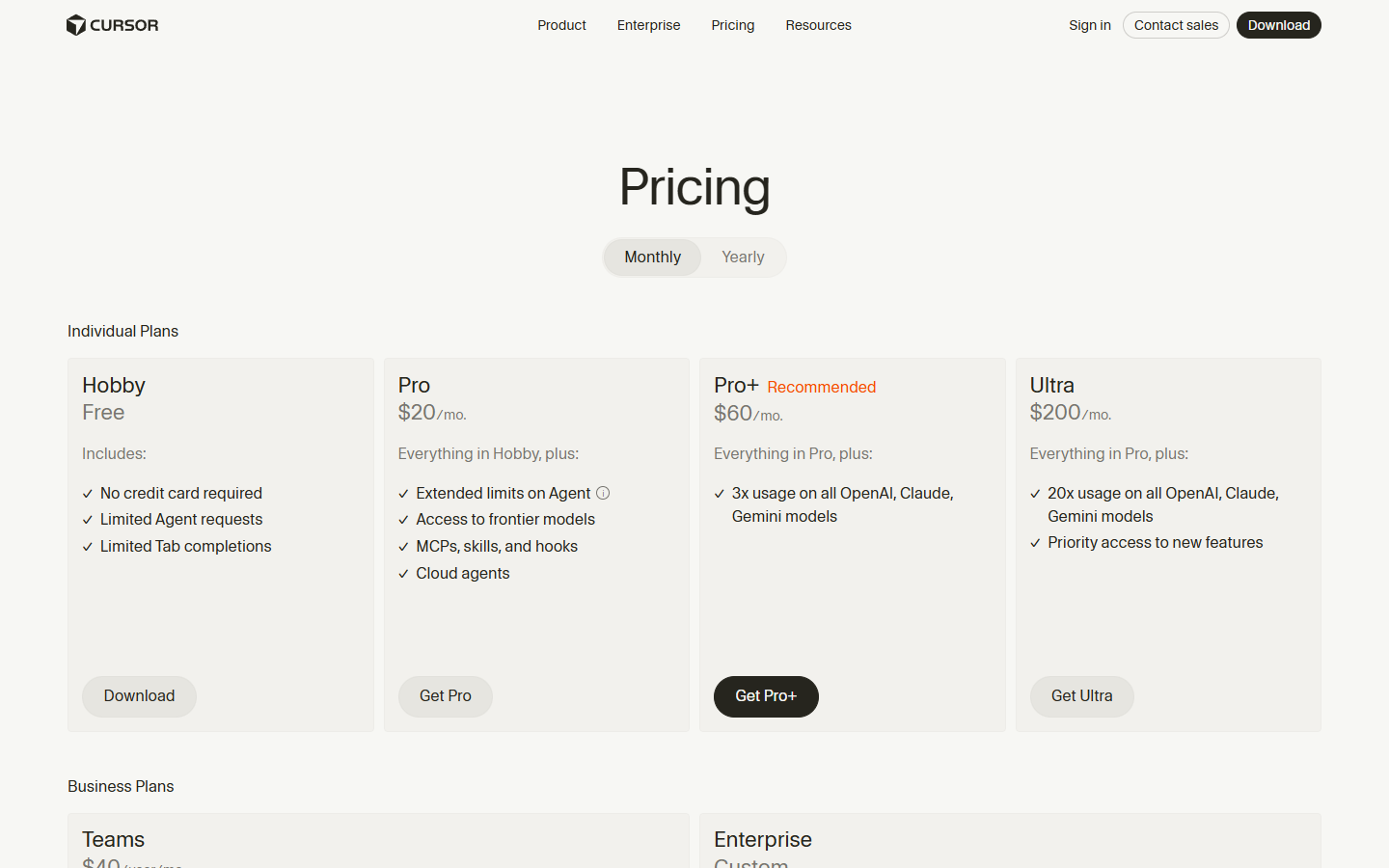

Les formules d'abonnement Cursor

Au-delà du prix par token de l'API, Cursor propose plusieurs formules d'abonnement pour accéder à ses outils au sein de l'éditeur de code :

Formule | Prix mensuel | Description |

|---|---|---|

Hobby | Gratuit | Accès limité aux fonctionnalités de base |

Pro | 20 $/mois | Usage standard avec accès à Composer 2 |

Pro+ | 60 $/mois | 3x plus d'utilisation que Pro |

Ultra | 200 $/mois | 20x plus d'utilisation que Pro |

Teams | 40 $/utilisateur/mois | Formule entreprise par utilisateur |

Sur les formules individuelles, l'utilisation de Composer fait partie d'un pool d'utilisation autonome avec un volume généreux inclus. Au-delà de ces limites, la facturation passe en mode usage.

Des tests indépendants menés par des développeurs montrent que pour une même tâche de codage, l'utilisation de Composer 2 dans Cursor coûte environ quatre fois moins cher que l'utilisation de Claude Opus ou GPT-5.4 via le même éditeur. Cet avantage économique est d'autant plus significatif pour les équipes de développement qui accumulent des millions de tokens quotidiennement.

La controverse Kimi K2.5 : pourquoi Cursor a caché l'origine du modèle

C'est l'aspect de cette annonce qui a le plus fait parler. Et pour cause : la manière dont Cursor a (d'abord pas) communiqué sur les fondations de Composer 2 soulève des questions importantes sur la transparence dans l'industrie de l'IA.

Chronologie des événements

Jeudi 18 mars : Cursor publie un billet de blog annonçant Composer 2. Le texte décrit les améliorations comme résultant d'un « premier pré-entraînement continu du modèle de base, combiné à un apprentissage par renforcement ». Aucune mention de Kimi K2.5 ou de Moonshot AI.

Vendredi 19 mars : Moins de deux heures après le lancement, un développeur identifié sous le pseudonyme @fynnso intercepte l'identifiant réel du modèle dans une requête API de Cursor : kimi-k2p5-rl-0317-s515-fast. Le nom trahit immédiatement l'origine : « Kimi K2.5 + RL ». Le développeur publie sa découverte sur X avec un commentaire cinglant : « Au moins, renommez l'identifiant du modèle. »

Voir le post de @amanrsanger sur X

Dans les heures qui suivent, Du Yulun, responsable du pré-entraînement chez Moonshot AI, tweete que le tokenizer de Composer 2 est « complètement identique » à celui de Kimi. Il interpelle directement Michael Truell, cofondateur de Cursor. Ce tweet sera ensuite supprimé.

Samedi 20 mars : Le vent tourne. Le compte officiel de Moonshot AI (@Kimi_Moonshot) publie un message de félicitations à l'équipe Cursor, confirmant que l'utilisation de Kimi K2.5 est autorisée dans le cadre d'un partenariat commercial via Fireworks AI.

Voir le post de @Kimi_Moonshot sur X

Le même jour, Aman Sanger, cofondateur de Cursor, reconnaît l'erreur : « Nous avons évalué beaucoup de modèles de base sur des évaluations basées sur la perplexité, et Kimi K2.5 s'est avéré être le plus performant. C'était une erreur de ne pas mentionner la base Kimi dans notre blog dès le départ. »

Lee Robinson renchérit : « Seulement un quart environ du calcul dépensé sur le modèle final provient de la base, le reste provient de notre entraînement. Nous ferons un pré-entraînement complet à l'avenir. »

Un problème de transparence récurrent chez Cursor

Ce n'est pas la première fois que Cursor est pris en défaut de transparence sur l'origine de ses modèles. En novembre 2025, lors du lancement de Composer 1, la communauté avait déjà découvert que le tokenizer du modèle était identique à celui de DeepSeek, un autre modèle open source chinois. Le modèle générait même occasionnellement du texte en chinois pendant l'inférence. À l'époque déjà, Cursor n'avait fourni aucune explication.

Cette récurrence pose un problème plus fondamental. Si Cursor construit systématiquement ses modèles sur des bases open source chinoises sans le divulguer, cela soulève des questions légitimes sur la valeur ajoutée réelle de l'entreprise et sur la confiance que les développeurs peuvent accorder à ses communications.

La licence modifiée de Kimi K2.5 et ses implications

Kimi K2.5 utilise une licence MIT modifiée qui contient une clause spécifique : tout produit commercial dépassant 100 millions d'utilisateurs actifs mensuels ou générant plus de 20 millions de dollars de revenus mensuels doit afficher de manière visible « Kimi K2.5 » dans l'interface utilisateur. Étant donné la valorisation de Cursor et sa base d'utilisateurs payants, il est très probable que ce seuil de revenus soit atteint.

Selon Moonshot AI, la conformité à la licence est assurée par l'accord commercial de Fireworks AI, l'intermédiaire technique entre les deux entreprises. Cette clarification a apaisé les tensions, mais n'a pas totalement dissipé les critiques de la communauté, notamment celles qui pointent le manque d'attribution dans l'interface de Cursor.

Ce que cette affaire révèle sur l'écosystème mondial de l'IA en 2026

Au-delà du cas Cursor, cette polémique met en lumière plusieurs tendances de fond dans l'industrie de l'intelligence artificielle.

La montée en puissance des modèles open source chinois

Le fait qu'une startup américaine valorisée à près de 30 milliards de dollars choisisse un modèle chinois open source comme fondation de son produit phare est en soi un signal fort. Kimi K2.5, DeepSeek et d'autres modèles issus de laboratoires chinois s'imposent comme des alternatives crédibles aux modèles occidentaux, notamment grâce à leurs architectures innovantes (Mixture of Experts) et à leur rapport performance-coût.

Le PDG de Hugging Face a lui-même souligné que cet épisode illustre l'influence croissante des modèles open source chinois dans l'écosystème mondial de l'IA. Ce constat vaut pour le codage, mais aussi pour la vision, le raisonnement et les capacités agentiques.

La frontière floue entre « modèle maison » et « fine-tuning »

Quand une entreprise prend un modèle open source, le pré-entraîne en continu et y ajoute un apprentissage par renforcement massif, à quel moment peut-elle appeler le résultat « son propre modèle » ? Cursor affirme que 75 % du calcul de Composer 2 provient de son propre entraînement. Mais la communauté pointe que sans la base Kimi K2.5, ces 75 % n'auraient pas abouti au même résultat.

Cette question n'est pas purement académique. Elle a des implications directes pour les investisseurs qui valorisent ces entreprises, pour les développeurs qui choisissent leurs outils, et pour la confiance globale dans l'industrie de l'IA.

L'importance de la transparence pour les utilisateurs

Pour les développeurs qui confient leur code à un assistant IA, savoir quel modèle tourne sous le capot est une information pertinente. Cela influence les choix de sécurité, de conformité réglementaire, et la compréhension des forces et limites de l'outil. Ne pas divulguer cette information, même si l'utilisation est parfaitement légale, érode la confiance.

Faut-il utiliser Cursor Composer 2 en 2026 ?

Malgré la polémique, les faits restent les faits. Composer 2 offre des performances de pointe pour le codage à une fraction du coût de ses concurrents. La vitesse d'inférence de plus de 200 tokens par seconde le rend particulièrement fluide dans un environnement de développement interactif. Pour les tâches quotidiennes de programmation, il représente un rapport qualité-prix sans équivalent sur le marché.

Si vous travaillez principalement sur de l'implémentation, du refactoring et de la correction de bugs, Composer 2 est probablement le meilleur choix disponible en termes de coût-efficacité. Si vos besoins portent davantage sur la planification architecturale et le raisonnement complexe, les modèles comme Claude Opus 4.6 ou GPT-5.4 restent des alternatives pertinentes, bien que nettement plus coûteuses.

La vraie question qui se pose désormais n'est plus technique, mais stratégique. Cursor a annoncé vouloir réaliser son propre pré-entraînement complet à l'avenir. Si l'entreprise y parvient en maintenant ce niveau de performances et ces prix, elle pourrait redéfinir durablement le marché de l'IA de code. En attendant, Composer 2 reste un produit remarquable, construit sur une fondation open source remarquable, et l'industrie ferait bien de retenir la leçon de transparence que cette polémique a imposée.

Envie d’automatiser ?

Audit gratuit de 30 min. On identifie vos 3 quick wins IA.

Réserver un audit gratuit →